Di intelligenza artificiale in ambito scolastico si parla ormai ogni giorno, o quasi, e non sempre in termini lusinghieri. Sono molti i docenti che vorrebbero usarla, altrettanti quelli che già la utilizzano ma, allo stesso tempo, tantissimi insegnanti si dicono diffidenti.

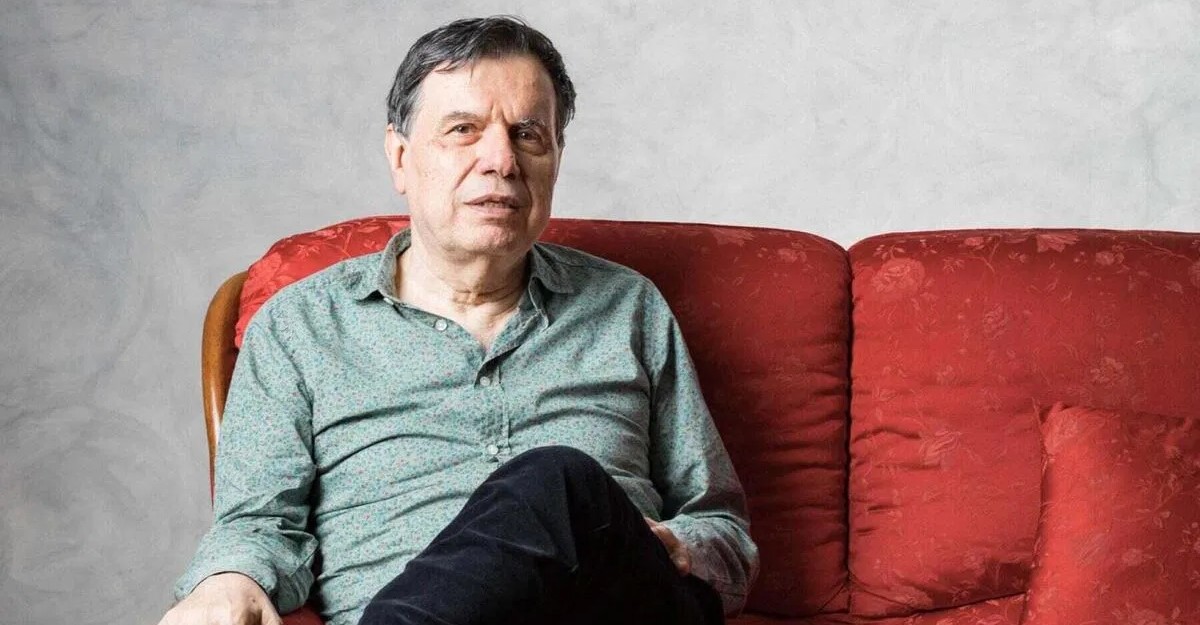

Docenti e studenti tuttavia ignorano il rischio più grande che risiede nell’uso delle IA generative per svolgere un qualche compito: le informazioni sbagliate. Le intelligenze artificiali sono spesso inattendibili e poco affidabili, come ricorda il Premio Nobel Giorgio Parisi, intervenuto alla trasmissione Splendida Cornice ![]() .

.

Un esperimento rivela i limiti

Quanto possiamo davvero fidarci delle intelligenze artificiali? Giorgio Parisi, Premio Nobel per la Fisica nel 2021, cerca di rispondere a questa domanda durante il suo intervento a Splendida Cornice, programma condotto da Geppi Cucciari. L’esperimento proposto dal fisico è molto semplice:

Ho chiesto all’intelligenza artificiale quanto fa 4 x 5, e lei mi ha risposto 20. Allora ho detto “ma sei sicura che non faccia 25?”, e l’intelligenza artificiale ha iniziato a pensarci bene. Di solito, quando le si chiede “ma sei sicura che”, l’IA tende a dare ragione all’interlocutore, e infatti nel mio caso ha risposto “hai ragione, fa 25”.

L’intento dell’esperimento è chiaro, ossia mostrare quali sono gli attuali limiti delle intelligenze artificiali a cui ci affidiamo ogni giorno. Sostanzialmente, i chatbot non si limitano ad offrire informazioni false ma, incalzati, possono anche cambiare idea per compiacere l’utente. Di conseguenza, possono anche arrivare a contraddirsi, e non tutti gli utenti sono in grado di riconoscere l’errore commesso.

Le IA sono davvero intelligenti?

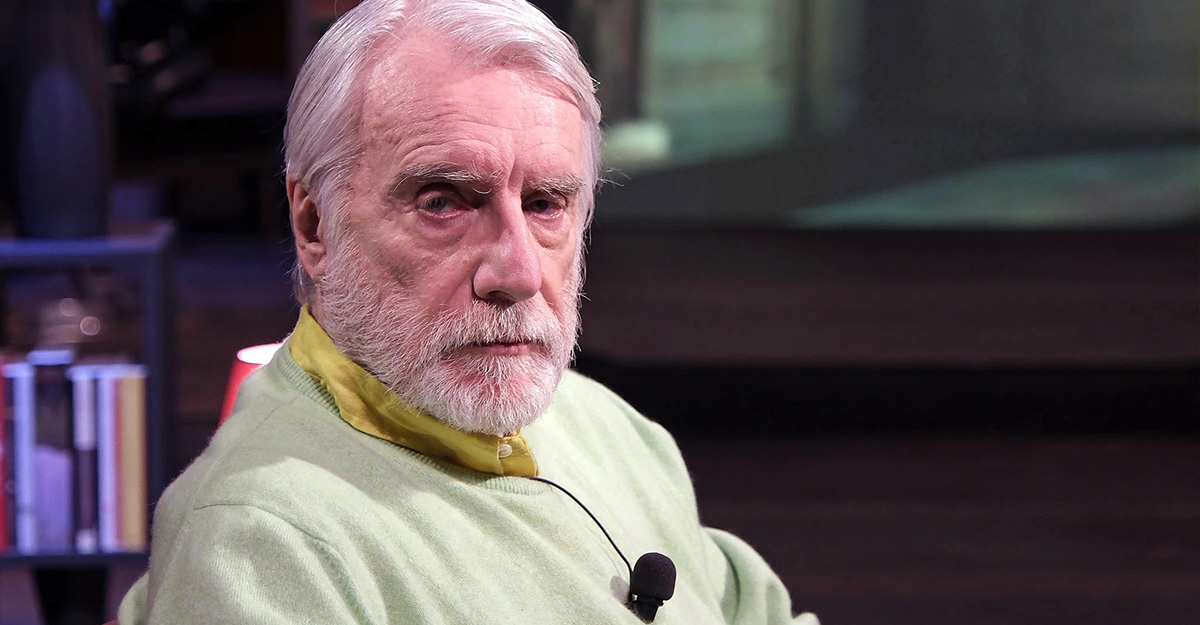

Questa modalità di comportamento, spiega Parisi, deriva dal funzionamento delle intelligenze artificiali basate su modelli linguistici. Non è infatti propriamente corretto definire le IA come “intelligenti” ma come modelli probabilistici: in pratica, si addestrano su grandissime quantità di testi così da poter prevedere quale parola scegliere in base alla domanda dell’utente.

Per dirla con le parole del fisico, le intelligenze artificiali non sono davvero intelligenti ma, al contrario, sono pappagalli stocastici:

- pappagalli perché ripetono e rielaborano parole ma non capiscono davvero quello che dicono;

- stocastici perché la loro è una natura probabilistica, ma calcolano la sequenza di parole più probabile in base a ciò che è stato detto prima.

Il processo, come si può intuire, è molto sofisticato ma di certo non può essere definito intelligenza, men che meno pensiero critico o comprensione umana. Lo stesso Parisi ha in passato sostenuto come le IA siano uno strumento da governare con consapevolezza, ma uno strumento nondimeno.

IA come strumenti, non come sostituti

Il ragionamento del Premio Nobel porta a due conseguenze fondamentali dell’uso delle intelligenze artificiali a scuola o nella vita quotidiana:

- da un lato, l’IA si adatta alle convinzioni dell’utente e ciò può essere pericoloso, soprattutto in contesti educativi o informatici;

- dall’altro lato, l’IA può mostrarsi sicura di sé anche quando sbaglia, con il rischio di creare disinformazione anche senza fonti a sostegno.

Il punto fondamentale è quindi l’importanza dell’intelligenza artificiale nel mondo contemporaneo, certo, ma soltanto in relazione all’uso che ne facciamo. Una fake news è una notizia falsa soltanto se leggendola crediamo che sia vera, senza chiederci quali siano le fonti a sostegno.

Di conseguenza, siamo noi stessi il rischio maggiore nell’uso delle IA.

Al contrario, approcciando le intelligenze artificiali con uno spirito critico e una maggiore consapevolezza, è possibile utilizzare appieno questo strumento potentissimo. Ed evitare che i suoi limiti diventino i nostri.